在人工智能蓬勃发展的今天,多模态技术正逐渐成为推动行业变革的关键力量。而通义千问最新推出的 Qwen2.5-Omni 模型,无疑是这一领域一颗璀璨的新星。它不仅能处理文本,还能解析图像、音频,甚至视频,多模态感知的能力让它在竞争激烈的 AI 市场中脱颖而出。

![图片[1]-通义千问 Qwen2.5-Omni:全模态 AI 的新纪元-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2025/03/1743095410249_0.png)

Qwen2.5-Omni:技术架构的革新

Qwen2.5-Omni 的核心创新在于其独特的 Thinker-Talker 双核架构。Thinker 模块如同大脑,负责处理多模态输入,生成高层语义表征和对应文本内容;而 Talker 模块则类似发声器官,以流式方式接收 Thinker 输出的语义表征和文本,流畅合成离散语音单元。这种架构不仅提高了模型的处理效率,还保证了输出的自然性和稳定性。

此外,Qwen2.5-Omni 还引入了 TMRoPE(Time-aligned Multimodal RoPE)位置编码技术,通过时间轴对齐实现视频与音频输入的精准同步。这些技术的结合,使得 Qwen2.5-Omni 在多模态任务中表现卓越,能够实现完全实时交互,支持分块输入和即时输出。

![图片[2]-通义千问 Qwen2.5-Omni:全模态 AI 的新纪元-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2025/03/1743095410249_1.png)

多模态任务的佼佼者

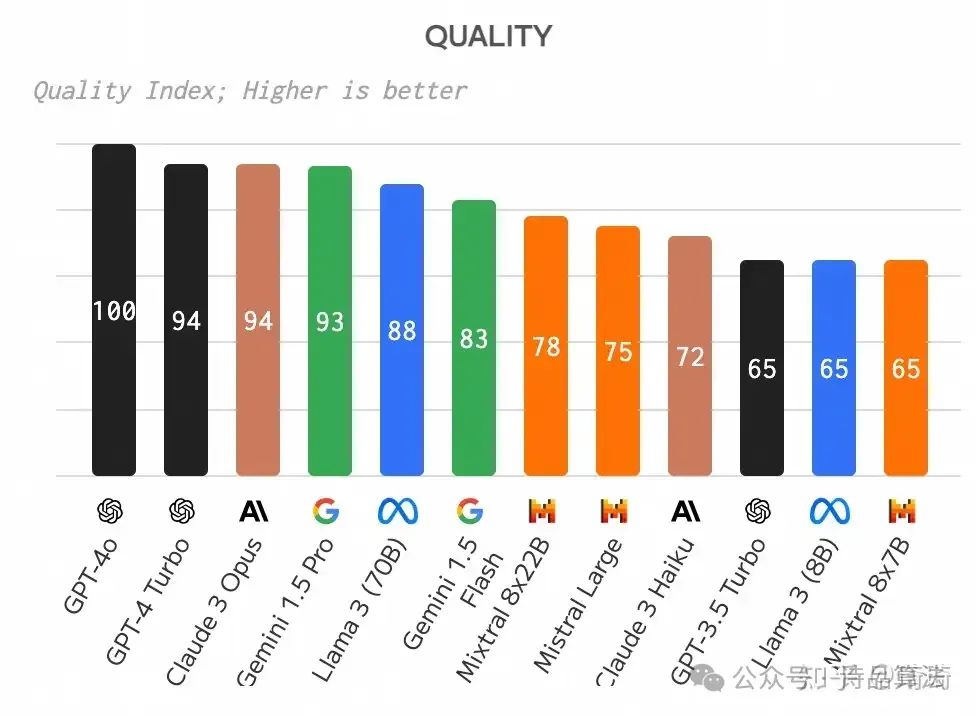

在性能方面,Qwen2.5-Omni 展现出了令人惊叹的实力。它在多模态任务 OmniBench 评测中达到了 SOTA(State of The Art)的表现,多项指标刷新了纪录,远超谷歌 Gemini-1.5-Pro 等同类模型。在单模态任务中,Qwen2.5-Omni 同样表现出色,在语音识别、翻译、音频理解、图像推理、视频理解以及语音生成等多个领域中均表现优异。

特别是在语音生成方面,Qwen2.5-Omni 在 seed-tts-eval 语音生成基准中展现出与人类水平相当的语音合成能力。这意味着它不仅能很好地与世界进行实时交互,还能轻松识别音视频情绪,为用户提供更加智能、自然的多感官交互体验。

![图片[3]-通义千问 Qwen2.5-Omni:全模态 AI 的新纪元-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2025/03/1743095410249_2.png)

让 AI 触手可及

Qwen2.5-Omni 的强大性能,使其在众多应用场景中大放异彩。在视频通话中,它能正确识别周围环境,按照用户需求推荐餐馆;在厨房里,它又化身“智能菜谱”,一步步指导用户变成大厨。这些实际应用案例,充分展示了 Qwen2.5-Omni 在多模态交互方面的无限潜力。

更重要的是,Qwen2.5-Omni 的体量小,易部署,家用电脑即可运行。这一特点使得全模态 AI 真正触手可及,为普通用户和开发者都提供了极大的便利。

推动 AI 民主化

阿里云在发布 Qwen2.5-Omni 的同时,也在 Hugging Face、ModelScope、DashScope 和 GitHub 等多个平台进行了开源。这一举措不仅展示了通义千问对于开放合作的重视,也体现了对 AI 民主化发展的承诺。用户在这些平台上可通过简易的 Demo 体验互动功能,享受 Qwen2.5-Omni 所带来的全新感受。

借助 QwenChat,用户还能够开启语音或视频聊天,感受技术的魅力与强大。这种开源开放的态度,无疑将吸引更多开发者和研究者参与到全模态 AI 的探索中来,共同推动这一领域的快速发展。

开启智能交互新时代

Qwen2.5-Omni 的发布,标志着人工智能在多模态感知领域迈出了重要的一步。它不仅在技术上实现了突破,更在应用场景和用户体验上带来了全新的变革。随着这一模型的不断优化和推广,我们有理由相信,全模态 AI 将在更多领域得到应用,为人们的生活和工作带来更多的便利和惊喜。

未来,通义千问将继续致力于技术创新,不断拓展 Qwen 模型家族的能力边界,为人工智能的发展注入新的活力。而 Qwen2.5-Omni 所开启的智能交互新时代,也将为人类与机器的沟通搭建起更加自然、高效的桥梁,让我们共同期待这一美好未来的到来。