【导语】:

在人工智能的浪潮中,我们正迎来一个全新的时代。笔者将带您深入了解阿里云官网推出的通义千问大模型,这是一款由阿里巴巴通义千问团队开发的革命性产品,它不仅代表了技术的前沿,更是智能未来的钥匙。

通义千问大模型:智能的多面手

通义千问大模型是一系列大规模语言和多模态模型,它们能够在大规模、多语言、多模态数据上进行预训练,并在高质量语料上后训练,以与人类偏好对齐。这些模型不仅能够执行自然语言理解、文本生成、视觉理解、音频理解等任务,还能在工具调用、角色扮演、智能体等多种场景中大显身手。

核心概念介绍:技术的力量

1. 因果语言模型(Causal Language Models)

因果语言模型是一种自回归语言模型,根据序列中的前导 token 预测下一个 token。它们在生成连贯且具有上下文关联性的文本方面表现出色,适用于文本补全和生成任务。

2. 预训练(Pre-training)和基模型(Base models)

预训练是在大量文本语料库上训练的基本模型,用于捕捉语言的统计模式和结构,使其生成连贯且具有上下文关联性的文本。这些模型具有多功能性,可以通过微调适应各种自然语言处理任务。

3. 后训练(Post-training)和指令微调模型(Instruction-tuned models)

指令微调语言模型是专门设计用于理解并以对话风格执行特定指令的模型。这些模型经过微调,能准确地解释用户命令,并以更高的准确性和一致性执行任务。指令微调模型会使用包含指令示例及其预期结果的数据集进行额外训练。

4. Tokens & Tokenization

Token 词元 代表模型处理和生成的基本单位,可以表示文本中的文本或特定功能。Tokenization 是将文本分割成 token 的过程,词表大小对模型性能和多功能性有重大影响。

5. Byte-level Byte Pair Encoding(BPE)

Qwen 采用字节对编码方法,用最少的 token 表示文本的 token 组合。这种方法确保了不存在于词表中的所有文本都可以转换为 token 序列。

6. 控制 Token 和对话模板

控制 token 和对话模板作为指导模型行为和输出的机制。控制 token 插入到序列中的特殊 token,表示元信息。对话模板为对话交互提供了结构化的格式,确保对话模型生成过程的精确控制。

7. 长度限制

Qwen 模型可以处理 32K 或 128K token 长的文本,其中 8K 长度可作为输出。预训练时每份文档或后训练时每轮对话的长度取决于具体的应用场景和预训练时的情况

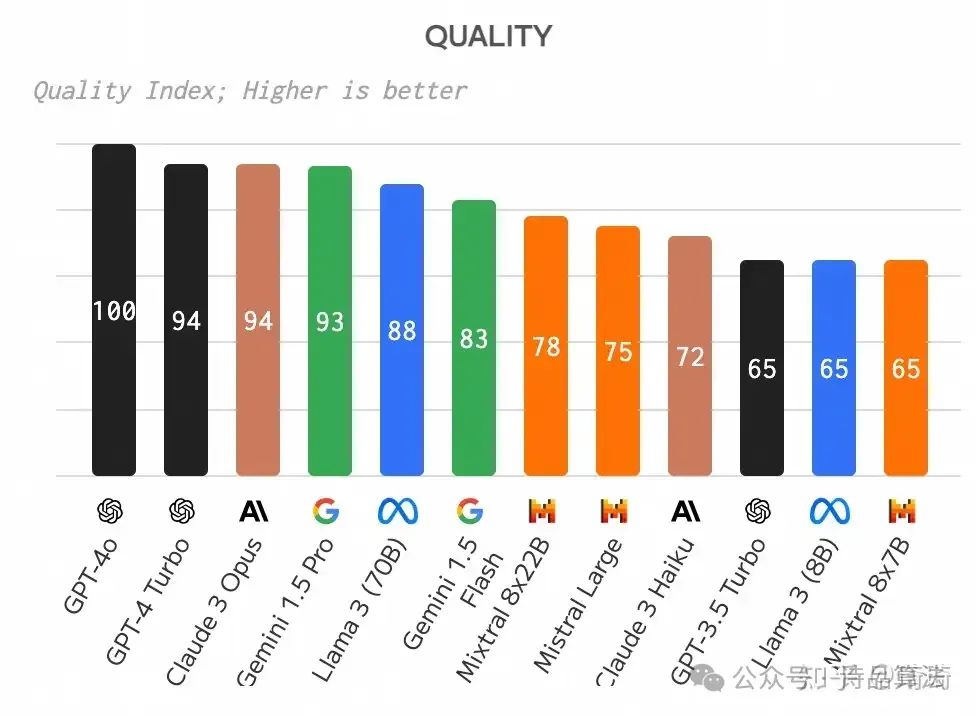

开源模型:共享智慧

通义千问不仅提供专有版本,还有开源模型供开发者使用。这些模型包括不同规模的语言模型、视觉语言模型和音频语言模型,满足不同场景的需求。

结语

通义千问大模型的出现,不仅推动了自然语言处理技术的发展,更为我们打开了一扇通往智能未来的大门。无论是企业还是个人,都能从中找到属于自己的智能解决方案。