![图片[1]-阿里云通义千问,开源!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/08/1722632537299_0.gif)

分享一个好消息——通义千问,开源了!

昨天,通义千问70亿参数通用模型Qwen-7B和对话模型Qwen-7B-Chat上架魔搭,两款模型均开源、免费、可商用。

![图片[2]-阿里云通义千问,开源!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/08/1722632537299_1.png)

今年4月,阿里云推出自研大模型通义千问,引发井喷式的市场需求。此次小型化模型版本开源,有望抹平模型使用门槛,让海量中小企业和AI开发者更早、更快地用上通义千问。

Qwen-7B是支持中、英等多种语言的基座模型,在超过2万亿token数据集上训练,上下文窗口长度达到8k。

Qwen-7B-Chat是基于基座模型的中英文对话模型,已实现与人类认知对齐。

开源代码支持对Qwen-7B和Qwen-7B-Chat的量化,支持用户在消费级显卡上部署和运行模型。用户既可从魔搭社区下载模型到本地部署,也可以在魔搭上一键拉起阿里云机器学习平台PAI,在云端对模型进行微调、部署和推理。

如果开发者想开箱即用地调用Qwen-7b和Qwen-7b-chat,可通过阿里云模型API平台灵积来测试调用通义千问API。阿里云为用户提供包括模型下载、训练、部署、推理等在内的全方位服务。

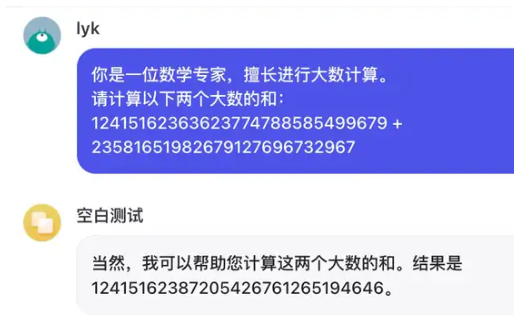

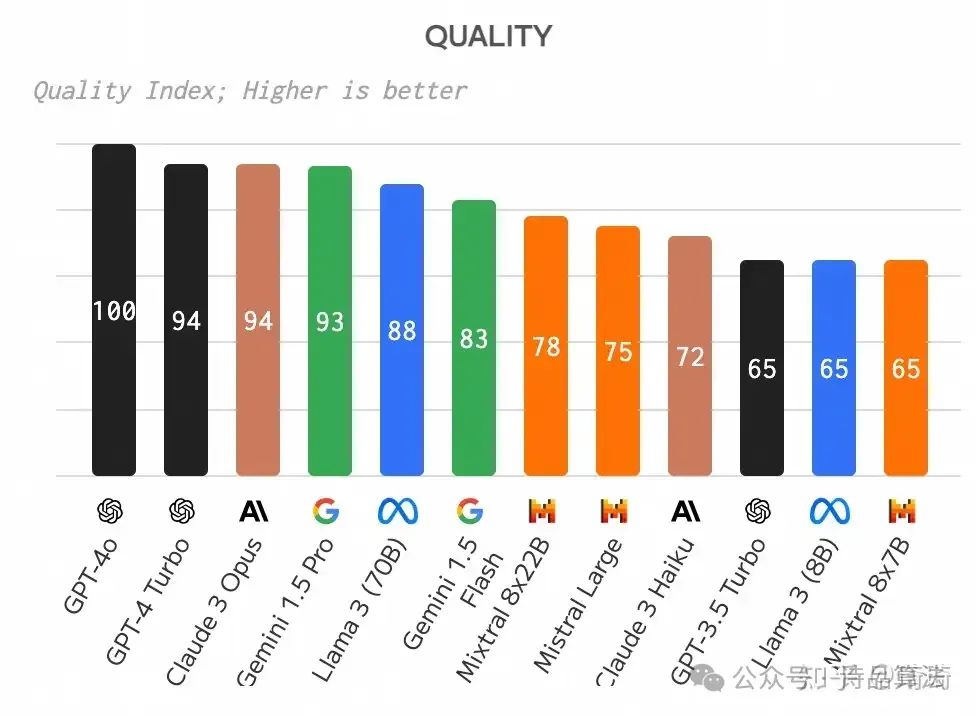

通义千问7B预训练模型在多个权威基准测评中表现出色,中英文能力远超国内外同等规模开源模型,部分能力甚至“跃级”赶超12B、13B尺寸开源模型。

在英文能力测评基准MMLU上,通义千问7B模型得分超过一众7B、12B、13B主流开源模型。该基准包含57个学科的英文题目,考验人文、社科、理工等领域的综合知识和问题解决能力。

在中文常识能力测评基准C-Eval上,通义千问在验证集和测试集中都是得分最高的7B开源模型,展现了扎实的中文能力。相比英文世界热闹的AI开源生态,中文社区缺少优秀的基座模型。通义千问的加入有望为开源社区提供更多选择,推动中国AI开源生态建设。

![图片[3]-阿里云通义千问,开源!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/08/1722632537299_2.png)

在数学解题能力评测GSM8K、代码能力评测HumanEval等基准上,通义千问7B模型也有不俗表现,胜过所有同等尺寸开源模型和和部分大尺寸开源模型。

开源大模型可以帮助用户简化模型训练和部署的过程,用户不必从头训练模型,只需下载预训练好的模型并进行微调,就可快速构建高质量的模型。

开源生态对促进中国大模型的技术进步与应用落地至关重要。今年7月,阿里云宣布将促进中国大模型生态的繁荣作为首要目标,向大模型创业公司提供智能算力、开发工具等全方位服务。2022年阿里云牵头发起AI模型社区魔搭,以AI模型为核心服务AI开发者。目前,魔搭聚集了20多家顶尖人工智能机构贡献的1000多款开源模型。

*开源地址:

魔搭ModelScope:

Hugging Face:

GitHub:

/ END /