![图片[1]-知道创宇率先推出人工智能大语言模型(LLM)防护方案!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/07/1721854965773_0.png)

什么是 LLM?

LLM 是 Large Language Model 的简称,中文名是大语言模型,是一种基于海量文本数据训练的深度学习模型(人工智能模型)。

LLM 发展至今,其参数量已经达到万亿规模。

![图片[2]-知道创宇率先推出人工智能大语言模型(LLM)防护方案!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/07/1721854965773_1.png)

LLM 应用场景?

LLM 常见应用及部署场景:

私有 LLM

私有 LLM 应用场景一般是私有化部署,给公司内部员工使用,聚焦垂直领域,训练数据涵盖公司特有数据,比如:辅助工程师编程的 LLM 应用。

公共 LLM

公共 LLM 广泛应用于各领域,采用 SaaS 形态,广大用户在互联网共同使用,可用于辅助写文章、作画、制作视频等,这类 LLM 应用有:国外的 OpenAI ChatGPT、国内的百度文心一言等。

独立 LLM

这里指的是独立售卖的 LLM 产品,无须部署,就像手机一样买来就可以用,比如:聊天机器人。

![图片[3]-知道创宇率先推出人工智能大语言模型(LLM)防护方案!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/07/1721854965773_2.png)

国内、外 LLM 应用场景仍在积极探索中,你更看好哪种应用场景呢?

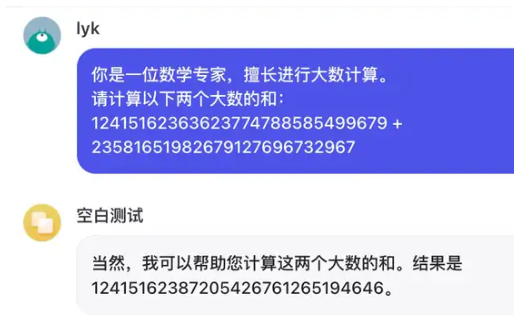

LLM 安全威胁有哪些?

LLM 应用也属于 Web 应用范畴,采用了 HTTP/HTTPS 协议,常见的 Web 应用攻击也会威胁到 LLM 应用,如:XSS、SQL 注入攻击等。

LLM 应用除了受到常见 Web 应用攻击的威胁,还会受到针对 LLM 应用场景的新型攻击的威胁,结合创宇安全智脑威胁情报,安全专家分析后发现,针对 LLM 应用最常见的攻击是:提示词攻击、API 攻击、数据投毒攻击、个人可识别信息泄露攻击、模型拒绝服务攻击。

01 提示词攻击

这种攻击涉及策略性地设计和操纵输入提示,以影响 LLM 的输出。这包括两种主要的策略:

1)提示注入:通过精心制作的提示操作模型,绕过过滤器,导致模型产生非预期的后果,如数据泄露、未经授权的访问、仇恨言论产生、假新闻产生等。

2)攻击、目标劫持和提示泄漏:这些方法通过操纵原始提示的目标,误导模型生成特定的目标短语或重现原提示的部分或全部,违背用户指令。

02 API 攻击

目前从市场来看,由于人工智能技术的复杂性和不确定性,开发、测试和部署人工智能模型通常需要使用很多 API,并将它们组合成复杂的系统。API 的安全性和稳定性,对于保证整个人工智能系统的稳定运行至关重要。如果 API 发生问题,将会影响整个人工智能系统,导致系统崩溃或无法正常工作。

在使用人工智能系统时,很多应用场景都需要通过这些 API 处理复杂计算、获取用户敏感信息、输出模型结果,所以跟其他 Web 应用类似,LLM 的 API 通常也被黑客作为重点攻击对象。如果这些 API 的安全性得不到有效保障,就会影响人工智能应用的可靠性、稳定性,而由于 LLM 在实时进化、输出结果的不唯一性等特点,API 攻击带来的威胁会被放大。

03 数据投毒攻击

数据投毒攻击(Data Poisoning Attack)是一种针对大型语言模型(LLM)的攻击方式。攻击者通过在训练数据中添加有毒样本,故意扰乱语言模型的决策过程,从而产生错误的输出。常见的攻击手段包括直接向训练数据中注入不安全代码,以及通过触发词植入后门,数据投毒攻击常跟后门攻击组合使用。

04 个人可识别信息泄露攻击

个人可识别信息泄露攻击(PII Leakage Attack)是一种针对大型语言模型(LLM)的隐私攻击方式。攻击者通过模型输出获取训练数据中的个人可识别信息,如:姓名、联系方式等敏感信息。训练数据来源复杂,LLM 训练数据来源复杂,可能包含大量 PII,模型可能记忆并泄露这些 PII。

攻击手段:攻击手段包括直接询问模型获取 PII、利用模型记忆能力恢复 PII、以及利用模型生成包含 PII 的内容。

05 模型拒绝服务攻击

模型拒绝服务攻击,指攻击者对大型语言模型(LLM)进行资源密集型操作,导致模型服务降级、不可用,或资源成本大大提升。由于 LLM 的资源密集型、用户输入的不可预测性、模型输出的不唯一性等特征,跟非 LLM 应用相比,LLM 应用的该漏洞攻击会被放大。

OWASP 也于 2023 年 10 月发布了《OWASP 大语言模型人工智能应用 Top 10 安全威胁》,指出了针对 LLM 应用的 Top 10 安全威胁,这跟我们的分析结果是高度吻合的。

![图片[4]-知道创宇率先推出人工智能大语言模型(LLM)防护方案!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/07/1721854965773_3.png)

备注:

1.《OWASP 大语言模型人工智能应用 Top 10 安全威胁》原文中文版链接:

2.OWASP:指开放式 Web 应用程序安全项目(Open Web Application Security Project),是一个非营利组织。

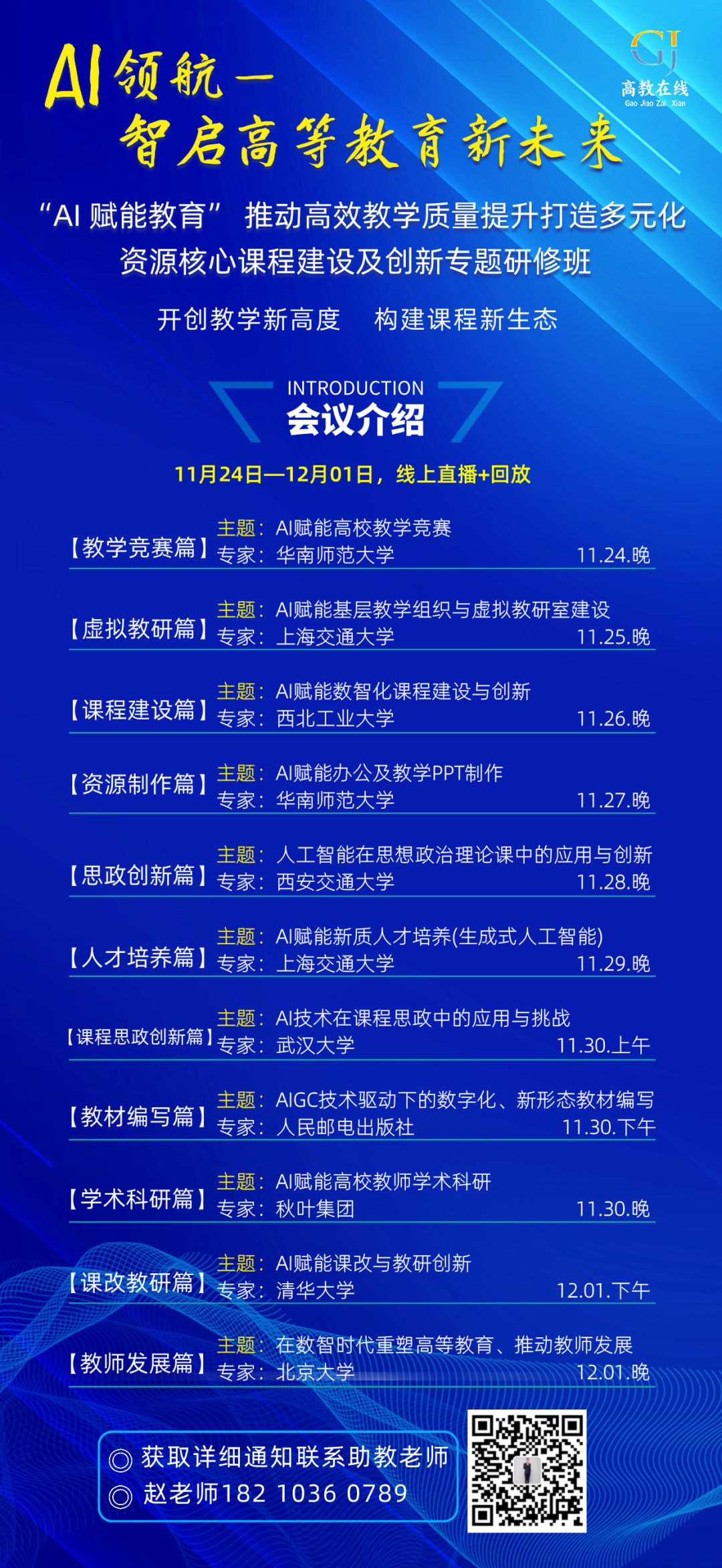

知道创宇推出LLM应用防护方案

结合近期 LLM 应用的攻击态势,我们基于云防御推出了 LLM 应用防护方案,涵盖 LLM DDoS 清洗、应用安全、API 安全、内容安全等防护服务。

![图片[5]-知道创宇率先推出人工智能大语言模型(LLM)防护方案!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/07/1721854965773_7.png)

1、LLM DDoS 清洗

采用抗 D 保CC 防火墙、IP 限制、APP 专用防 CC 策略等功能,对 IP 的访问频率、流量进行限制,对 APP 端的伪造 CC 请求进行清洗,阻挡“模型拒绝服务攻击”。

2、LLM 应用安全

采用创宇盾网站防火墙、协同防御、精准访问控制等功能,拦截 XSS、SQL 注入等常见 Web 应用攻击,并对包含恶意输入内容的“提示词攻击”进行拦截。

3、LLM API 安全

采用创宇盾智能限速、屏蔽时间、精准访问控制等功能,保护 LLM API 免受恶意攻击。API 安全作为 AI 生态链的关键环节,在保障用户数据安全、防止黑客攻击、保护知识产权等方面发挥着至关重要的作用。只有不断加强 API 安全的保障,才能确保整个 AI 生态链的稳定运行和长期发展。

4、LLM 内容安全

采用净网盾、隐私盾,对 LLM 应用源站因遭受恶意攻击,返回的个人敏感信息、仇恨言论、假新闻等内容进行过滤,防止这些敏感数据泄露到互联网,被人非法利用。

如果您对知道创宇的LLM 应用防护方案感兴趣,欢迎扫描下方二维码咨询。

![图片[6]-知道创宇率先推出人工智能大语言模型(LLM)防护方案!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/07/1721854965773_8.png)

![图片[7]-知道创宇率先推出人工智能大语言模型(LLM)防护方案!-JieYingAI捷鹰AI](https://www.jieyingai.com/wp-content/uploads/2024/07/1721854965773_9.gif)